Alexa, google o siri ¿Nuestros datos corren peligro?

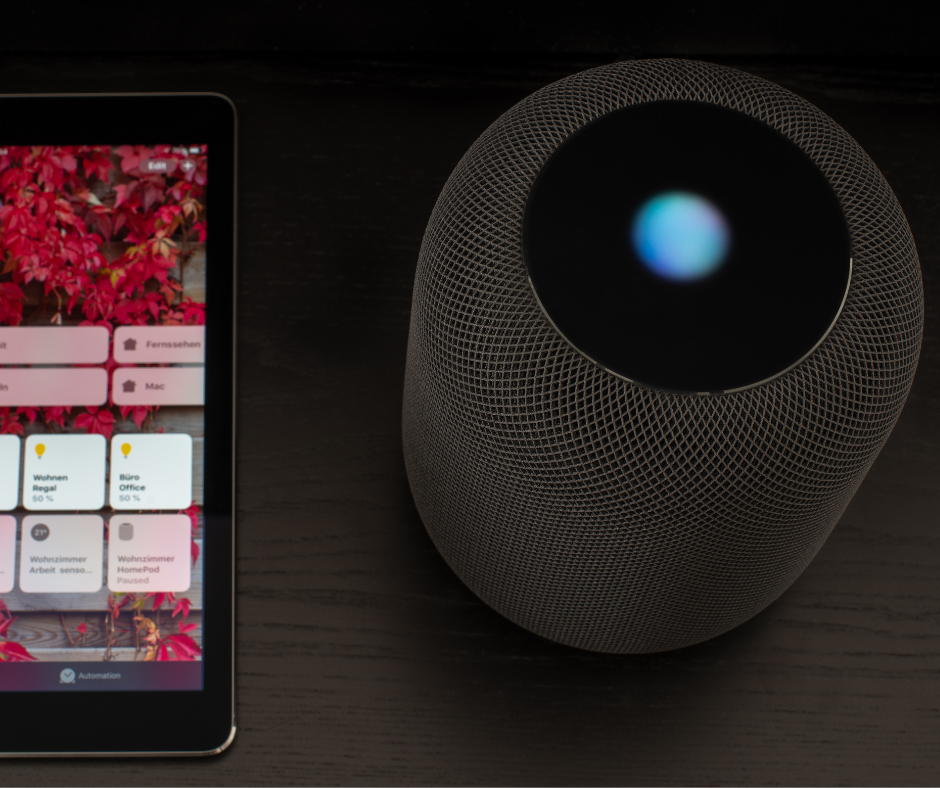

Tanto los altavoces inteligentes comercializados por primera vez en 2014 como los asistentes virtuales implementados en los iPhone en 2010 son tecnología relativamente nuevas. Su función principal es responder a nuestras preguntas o peticiones, desde pedirles la hora, ponernos música, saber qué tiempo hace hoy hasta preguntas más complejas incluso cuentan chistes. Incluso si están conectados con otros elementos de la casa son capaces de encender luces, bajar persianas, apagar y encender la televisión…

Estas tecnologías utilizan una palabra de activación “ok google”, “hey siri”, “alexa” utilizan un método de rastreo continuo para poder responder en el momento que lo solicitamos. Grabando las interacciones cuando se utilice la palabra de activación.

En la red social “tiktok” se ha hecho viral un video de la criminóloga Maria Perados en la que el altavoz de amazon (Alexa) no solo la escuchaba también grababa el audio sin haber utilizado la palabra de activación, este altavoz enciende una luz azul en la parte inferior para que sepamos cuando está en funcionamiento. Aunque la influencer en su propio video aclara que estos datos y audios no pueden ser utilizados indebidamente por estas empresas y los propios especialistas como David Arroyo investigador del cisc aclara “Hay muchos intereses para que eso no suceda, porque supondría la pérdida de confianza en todos los dispositivos y un perjuicio económico muy considerable para estas empresas”

Estudios ratifican esta información además de aclarar que son fallos de apenas unos segundos y que su contenido son conversaciones banales del día a día de los usuarios.

Pero este no es el mayor problema que esta usuaria ha expresado en sus redes sociales. ¿Qué pasaría si estas empresas sufrieron un ataque de ciberseguridad y robaran todas estas pistas de audio? Incluso solo con las grabaciones que si utilizamos la palabra de activación esto podría ser peligroso ya que podrían clonar nuestra voz mediante inteligencia artificial, suplantarnos la identidad, estafar a otras personas, pedir trámites en bancos y una larga lista de acciones que podríamos sufrir si se diera este caso.

A pesar de que estas empresas tienen sistemas para prevenir estos ataque de hackers para velar por la seguridad y los datos de sus clientes, te explicaremos brevemente cómo desactivar la opción de grabación de Alexa para que nadie pueda tener acceso a estas pistas de audio. Abre tu cuenta de amazon y dirígete al apartado de privacidad se desplegará una pestaña para elegir cuánto tiempo se guardarán estas grabaciones donde podemos seleccionar la opción de no guardarlas nunca.

Aunque en el caso de que estas grabaciones sean utilizadas sean muy poco probables mejor asegurarse y no exponerse a este riesgo.

Todos los derechos reservados

Comentarios